测试、监控与持续改进

在复杂的 AI 系统中,测试、监控和持续改进是保证系统稳定性和用户满意度的关键。

功能测试与验证

确保代码的正确性和系统的稳定性是测试的主要目标:

单元测试

- 使用 Jest 或 Mocha 等工具编写测试案例,验证每个模块的功能。

- 自动化测试流程,通过 CI/CD 集成进行自动测试。

集成测试

- 确保不同系统模块能够无缝协同工作。

- 使用 Cypress 等工具模拟用户交互,验证端到端流程。

对于我们的示例,执行测试命令:

npm run test

你将看到类似如下测试输出摘要:

> npm run test

> [email protected] test

> vitest

✓ tests/unit/fast-ingest.test.ts

✓ tests/integration/ingest-retriever.test.ts

✓ tests/unit/retriever.test.ts

Test Files 3 passed (3)

Tests 12 passed (12)

Duration 194ms

主要测试内容包括:

- 集成测试:验证中英文检索、上下文过滤、回退机制。

- 单元测试:确保检索器语言过滤、元数据处理等功能正确。

- 所有测试均通过,系统稳定性和多语言支持已验证。

性能与模型监控

设立监控指标可以有效把握系统的健康状态,并及时发现问题。

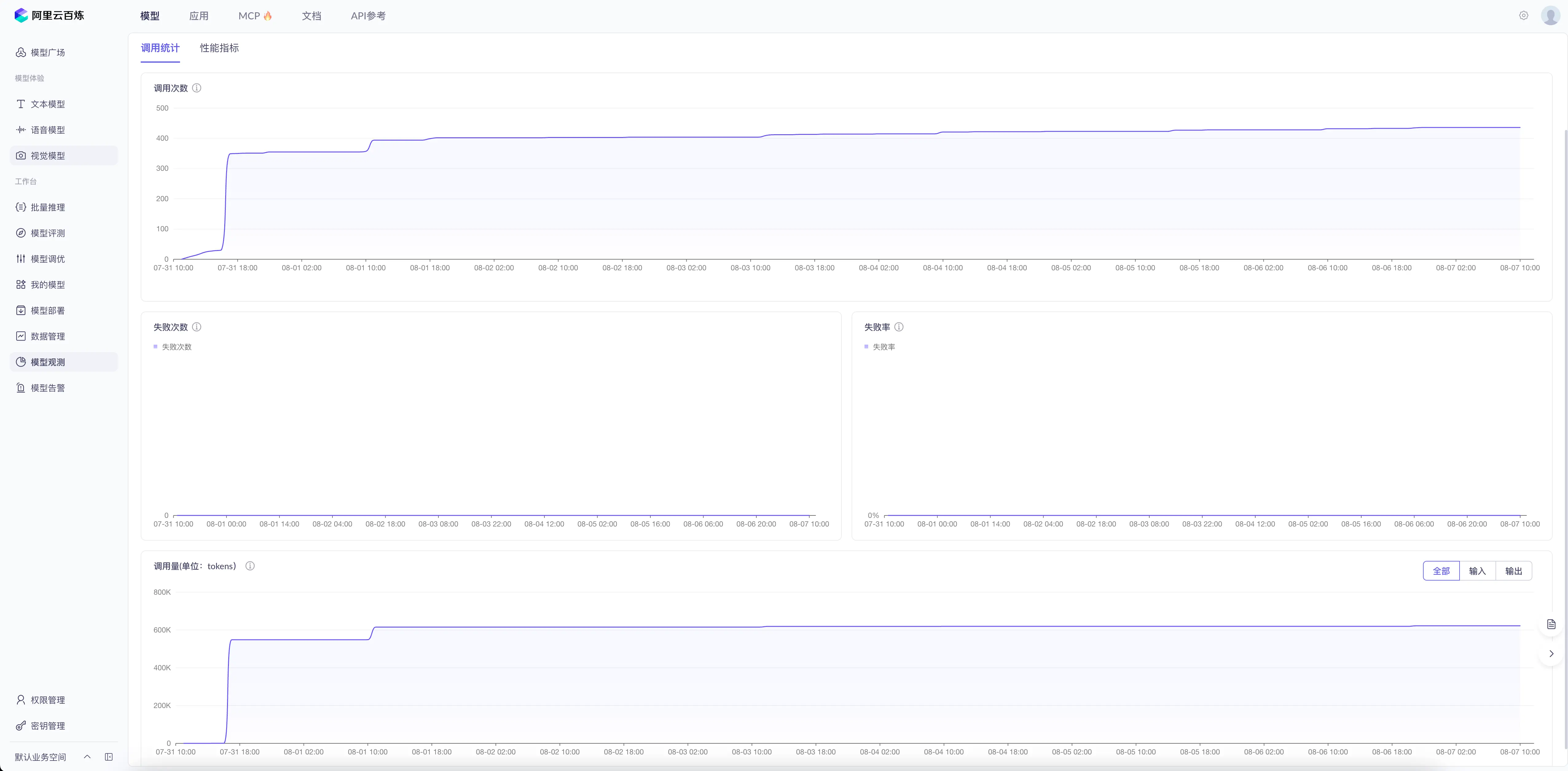

模型调用监控

利用阿里云百炼大模型的监控功能,实时查看模型调用次数、延迟和异常情况。通过可视化界面分析模型性能,优化调用策略。

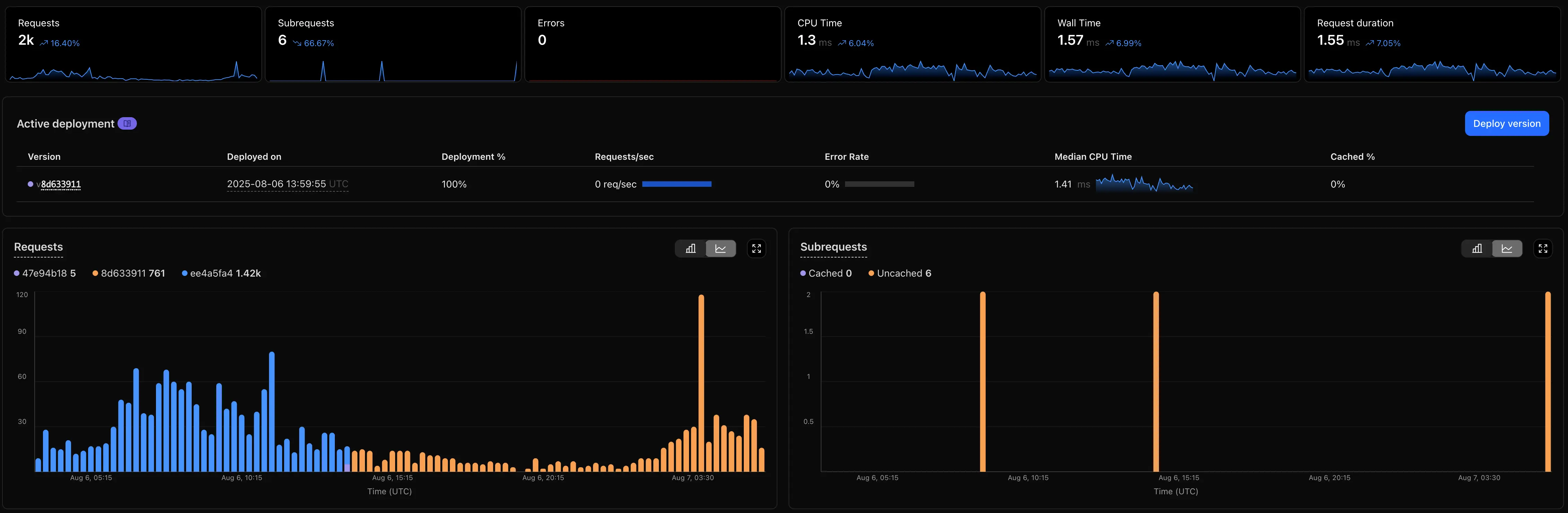

流量与向量监控 使用 Cloudflare 内置的 Worker 和 Vectorize 服务,监控 API 流量、请求分布及向量存储情况。结合 Cloudflare 仪表盘,追踪系统负载和向量检索效率,及时调整资源分配。

通过 Cloudflare Vectorize 服务,可以实时监控向量存储和检索的状态,分析数据分布和检索效率,及时发现性能瓶颈。

利用 Cloudflare Worker 仪表盘,直观查看 API 流量、请求分布和系统负载,帮助运维团队及时调整资源,保障服务稳定运行。

用户反馈收集与迭代优化

通过用户反馈不断改进产品:

反馈渠道

- 提供表单、邮件、在线聊天等多种反馈方式,获取用户意见。

- 定期整理和分析反馈,识别关键改进点。

快速迭代

- 根据反馈规划敏捷迭代,迅速响应需求变化。

- 持续交付新功能和改进,增强用户体验和满意度。

通过有效的测试、监控和持续改进机制,结合阿里云百炼和 Cloudflare 的监控能力,确保系统始终保持最佳状态,满足用户不断变化的需求。收集用户反馈,通过迭代开发不断优化用户体验和系统性能。

小结

通过本节的介绍,您已经了解了测试、监控和持续改进在 RAG 系统中的重要性。我们重点讲解了功能测试、模型与流量监控、性能指标以及用户反馈收集与迭代优化等关键内容。这些实践将帮助您确保系统的稳定性和用户满意度,为持续改进提供有力支持。接下来,您可以将这些知识应用到实际项目中,不断提升系统的质量和用户体验。